Déresponsabilisation généralisée

Mes lectures de cette semaine ont toutes un fil rouge qui me trotte dans la tête depuis un moment : la déresponsabilisation.

L'utilisation de l'informatique pour se soustraire à nos responsabilités. Les chercheurs en médecine dans l'article de Next anticipent les problèmes à venir quand les outils probabilistes qui vont leur être imposés vont statistiquement produire des erreurs. Qui sera responsable ? Le médecin qui n'aura pas osé contredire la machine ou le développeur de celle-ci ?

Le blog de "Dans les algorithmes" n'est pas centré sur la question de la responsabilité. Il soulève le fait que l'introduction de l'IA pour augmenter la productivité des employés vise surtout à pouvoir diminuer la valeur du travail. Les emplois continueront d'exister mais seront réduits à valider les décisions générées par l'ordinateur. De fait, l'employé reste responsable des décisions "suggérées" par son outil mais :

- Il doit approuver les décisions rapidement (sinon il n'y aura pas de gain de productivité)

- Il n'a aucun élément pour lui permettre de juger de la décision, les IA ne produisant qu'une réponse sans aucune explication.

Enfin, le blog de @ploum@mamot.fr illustre ce paradoxe de l'arbitrage où le rôle de l'arbitre est simplement d'endosser la responsabilité d'une décision prise indépendamment de son jugement.

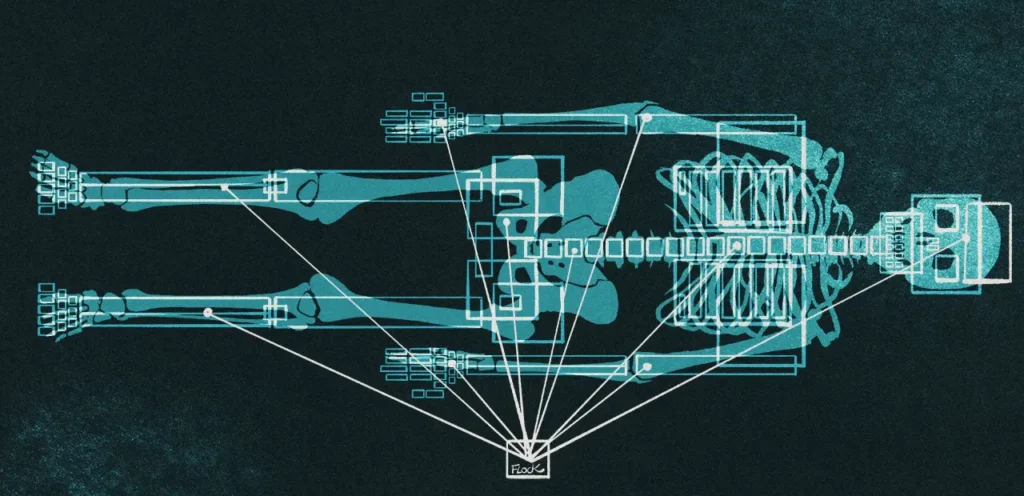

L'informatisation, la mesure de plus en plus de paramètres pour réduire chaque individu au stéréotype d'une cohorte prédéfinie n'est pas nouvelle. L'IA n'est que la continuité de cette politique, accélérant le processus tout en soulageant les décideurs, les "responsables", de toute responsabilité.